Tanks, drones, tourelles : les armes létales autonomes, ces équipements militaires boostés à l’intelligence artificielle et ne nécessitant aucune intervention humaine, inquiètent. Beaucoup, même, tant elles ne cessent de se développer alors que les superpuissances mondiales se refusent à encadrer leur production.

À voir aussi sur Konbini

En 2019, lors d’un sommet organisé à Genève en compagnie d’experts en intelligence artificielle, le secrétaire général des Nations unies, António Guterres, qualifiait les armes létales autonomes de “politiquement inacceptables” et de “moralement répugnantes”, appelant à leur interdiction pure et simple dans le monde.

Depuis 2017, de nombreux lanceurs d’alertes prédisent le pire si les nations ne se décident pas à développer un consortium international sur l’utilisation de l’intelligence artificielle dans le domaine militaire. Cette année-là, Bruno Stagno, directeur exécutif adjoint de l’ONG Human Rights Watch, qui milite pour le respect des droits humains, dénonçait sur Franceinfo l’irresponsabilité de ceux qui souhaitent miser sur les armes létales autonomes :

“Plusieurs États, comme Israël, Singapour, la Russie, le Royaume-Uni, les États-Unis, la Corée du Sud et quelques autres se manifestent déjà pour développer ce genre de technologies. Lors d’une ‘frappe immorale’, qui est le responsable ? Est-ce le concepteur de l’algorithme, celui qui gère le logiciel, celui qui surveille, le commandement militaire ? On a là un petit groupement d’États qui se refuse à considérer ces questions juridiques, morales et humanitaires.”

Justement, un nouveau rapport de Human Rights Watch, publié ce lundi 10 août, vient détailler le point de vue de 97 pays s’étant prononcés au sujet de la réglementation de ces “robots tueurs” – sobriquet évocateur utilisé pour ce genre d’armes.

Des négociations entre pays qui s’enlisent

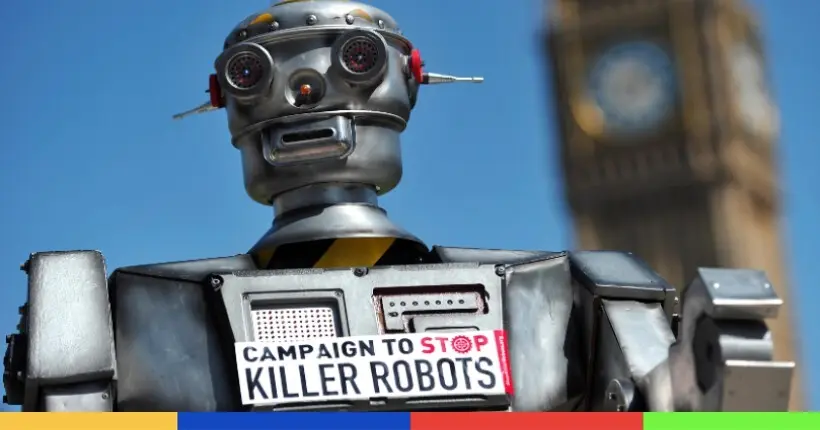

Les résultats présentés sont le fruit d’une grande consultation lancée en 2013 et appelée “Stop Killer Robots”. La campagne, soutenue par plusieurs associations, défend clairement l’hypothèse d’une interdiction, et tente de sensibiliser citoyens comme décideurs aux dangers des armes autonomes.

Ce tout premier “compte rendu international” traduit la volonté des nations à maintenir un contrôle humain sur les armes létales utilisant l’intelligence artificielle. Néanmoins, seuls trente des quatre-vingt-dix-sept pays s’étant prononcés se sont opposés formellement à l’utilisation de robots tueurs.

Et alors que l’organisation non gouvernementale maintient fermement que “le maintien d’un contrôle humain significatif sur l’usage de la force est un impératif éthique, une nécessité juridique et une obligation morale”, certains acteurs comme Israël, les États-Unis et la Chine continuent à développer massivement leurs systèmes d’armement, sans pour autant prendre position de manière ferme. En un mot, les négociations sont enlisées et la situation n’évolue pas.

En Europe, les deux principales puissances militaires que sont la France et l’Allemagne ont proposé que la CCW (Convention on Certain Conventional Weapons), ou CCAC (Convention sur certaines armes classiques) en français, accède à une décision restrictive mais “non juridiquement contraignante”. Une décision plutôt tiède, alors que la ministre de la Défense Florence Parly appelait pourtant elle aussi dès 2019 à l’interdiction des systèmes d’armes létales automatiques.

Le 22 juillet dernier, deux députés français – Claude de Ganay (LR) et Fabien Gouttefarde (LREM) – ont d’ailleurs présenté un rapport parlementaire pour presser l’encadrement des SALA – les systèmes d’armes létales autonomes. À rebours des inquiétudes de Humans Right Watch, ils y pointent notamment du doigt le risque de voir la France prendre un retard technologique considérable face aux autres superpuissances mondiales que sont la Chine, la Russie ou encore les États-Unis. Selon eux, il est nécessaire que la France s’engage sur la voie des armes létales autonomes.

Les robots tueurs sont déjà là

L’association des mots “robotique” et “intelligence artificielle” évoque d’emblée des œuvres fictionnelles d’anticipation comme Terminator ou Detroit: Become Human, où le danger prend une forme humanoïde et livre une guerre sans pitié à l’humanité.

Pourtant, s’il devait y avoir une législation sur les armes autonomes, cette loi concernerait à la fois les androïdes, les tourelles, les drones, les nano-robots et les missiles. Il faut s’éloigner des clichés, pour voir à quel point cette révolution industrielle est déjà engagée.

Les robots tueurs (notamment les drones) existent déjà, mais sont pour l’instant toujours pilotés par l’homme lorsqu’il est question d’abattre une cible. La technologie avançant très vite, les futurs théâtres d’opérations pourraient cependant voir des IA autonomes combattre sans intervention humaine.

“Le monde regarde et l’horloge tourne”, comme l’a très justement souligné le secrétaire général de l’ONU en 2019. Toute la difficulté de mesurer cette progression réside dans l’opacité du développement des armements militaires, et dans le nombre de micro-avancées que l’intelligence artificielle pourrait amener, de manière invisible.

Au cours du dernier Salon international de l’aéronautique et de l’espace – aussi appelé salon du Bourget –, à Paris, la start-up israélienne Rafael a présenté sa bombe planante SPICE‑250 (Smart, Precise Impact, Cost-Effective), un missile autoguidé par l’IA possédant une portée pouvant aller jusqu’à 100 km et ayant une charge explosive de 75 kg : un engin dévastateur qui fait craindre le pire en cas d’escalade entre le peuple palestinien et Israël autour de la bande de Gaza.

À la frontière entre la Corée du Sud et la Corée du Nord, un robot tueur est même déployé depuis 2013. La tourelle SGR-A1 développée par Samsung opère de jour comme de nuit pour repousser tout franchissement. Elle est armée d’une mitraillette et d’un lance-grenades, même si l’ordre de feu est toujours donné par un opérateur humain. Une réalité qui pourrait très vite changer. Il est désormais assez simple d’automatiser entièrement un équipement statique et déjà guidé par l’intelligence artificielle.

Cette course technologico-militaire bat son plein. Et comme l’a déclaré Vladimir Poutine sur un plateau de télévision en septembre 2017, “celui qui sera leader dans le domaine de l’intelligence artificielle sera le maître du monde”. Bien consciente de cela, la Russie a d’ailleurs testé la prochaine génération de ses tanks téléguidés en Syrie, lors de sa guerre contre Daesh.

Pour une coalition d’experts en intelligence artificielle s’étant exprimés dans une lettre ouverte en 2015, l’apparition toujours plus rapide de nouveaux dispositifs dans l’armée de terre, le domaine de l’espace ou l’aéronautique devrait signer une forme de “troisième révolution de l’armement”, après l’utilisation de la poudre et la découverte de l’arme nucléaire.

Des idées de sujet, des anecdotes concernant votre rapport à l’intelligence artificielle ? Dites-nous tout à hellokonbinitechno@konbini.com !